EY se refiere a la organización global, y puede referirse a una o más, de las firmas miembro de Ernst & Young Global Limited, cada una de las cuales es una entidad legal independiente. Ernst & Young Global Limited, una compañía británica limitada por garantía, no brinda servicios a los clientes.

Cómo EY puede ayudar

-

EY Studio+ ayuda a las organizaciones a construir experiencias diferenciadas que se adaptan a los clientes e impulsan un valor sostenible a largo plazo. Más información en studio.ey.com.

Leer más

Un informe reciente de EY sobre la creación de experiencias fiables basadas en la inteligencia artificial (pdf) destaca hasta qué punto el diseño puede depender del lenguaje, el ritmo y la claridad. En el informe, Miki Van Cleave, directora de Diseño de Chase, la división de banca minorista y comunitaria de JPMorganChase, destaca el esmerado cuidado que se debe poner en el diseño de las interacciones impulsadas por la inteligencia artificial. «Estamos aquí para generar confianza y partir de una base de comprensión de la mentalidad del consumidor», afirma Van Cleave. «Dedicamos una cantidad desmesurada de tiempo a pensar en el lenguaje que los clientes necesitan escuchar para que tengan muy claro lo que están haciendo. Por ejemplo, en lo que respecta a la detección de fraudes, dedicamos horas, días y semanas a analizar minuciosamente cada sustantivo, verbo y adjetivo de una página intersticial para asegurarnos de que ayude a los clientes a saber qué hacer».

La necesidad de claridad no es meramente superficial. Determina si las personas se sienten en control, especialmente en contextos de alto riesgo, como el financiero.

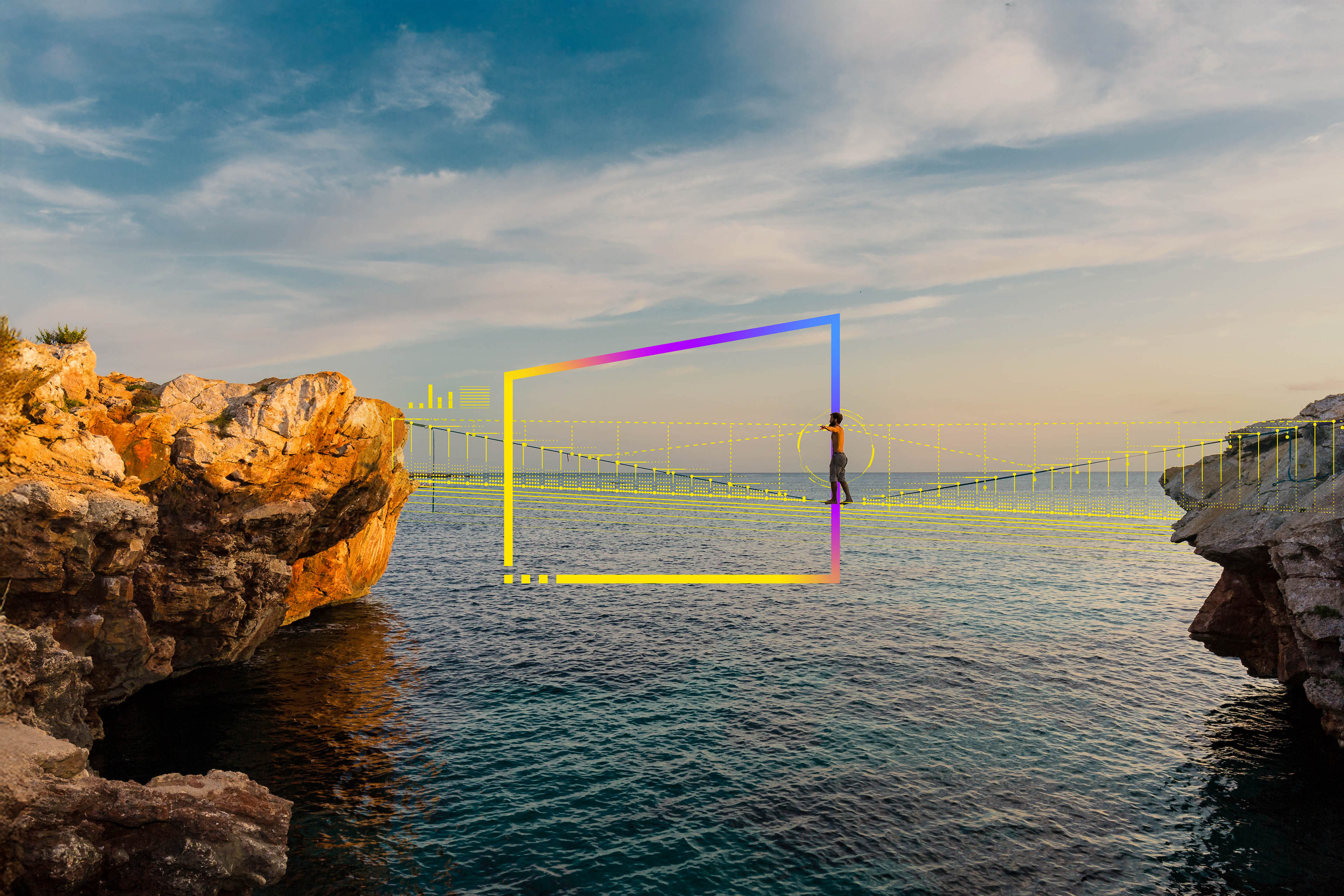

Los líderes no decidirán si la IA se vuelve más autónoma. Esa trayectoria ya está en marcha. Lo que sí pueden decidir es con qué grado de deliberación se introduce esa autonomía: dónde se limita, dónde se amplía y cómo se va generando confianza a lo largo del proceso.

Las organizaciones más exitosas no serán aquellas que se apresuren a implementar la IA en todos los ámbitos, ni aquellas que adopten una actitud de esperar y ver qué sucede. Utilizarán el diseño para marcar un ritmo deliberado: acelerarán allí donde ya existan la confianza y el valor, y reducirán el ritmo allí donde aún se requieran claridad, garantías o seguridad.