IA explicable: abordar la ansiedad ante la IA mediante la transparencia

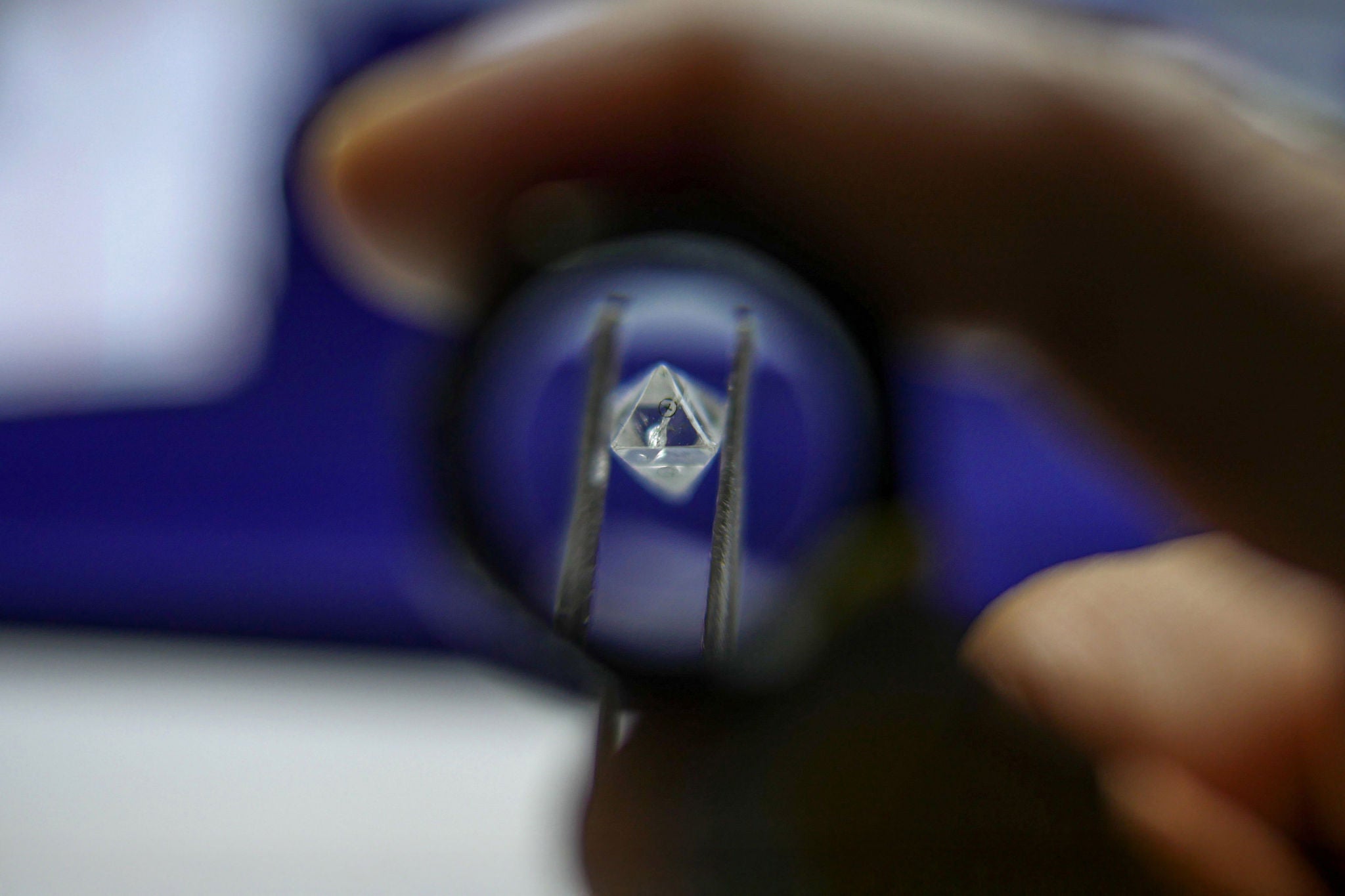

Una fuente de creciente preocupación sobre la IA es su problema de "caja negra": el desafío de explicar los procesos de toma de decisiones de los modelos avanzados de IA. A medida que estos modelos tomen cada vez más decisiones y medidas que afecten significativamente a la vida de los trabajadores y ciudadanos, inevitablemente aumentarán las demandas de transparencia sobre cómo se toman estas decisiones.

Resolver el problema es un desafío, debido a la gran complejidad de los modelos de aprendizaje profundo25, que no "piensan" como lo hacen los humanos. La lógica precisa por la que un modelo de IA llega a conclusiones específicas sigue siendo en gran medida opaca, incluso para sus desarrolladores.

El movimiento Explainable AI (XAI) está trabajando para abordar el problema. Grandview Research estima que el mercado global de XAI crecerá de 7.800 millones de dólares en 2024 a 21.000 millones de dólares en 2030, con una tasa compuesta de crecimiento anual (CAGR) del 18 %26. Además de la mayoría de los gigantes tecnológicos líderes, una gran cantidad de empresas emergentes están investigando y desarrollando soluciones en el ámbito de la XAI, entre ellas H20.ai27 (que ha desarrollado un «conjunto de herramientas de explicabilidad integral» para explicar los resultados de la IA) y Fiddler AI28 (que está desarrollando una "plataforma de observabilidad de la IA" que permite a las empresas crear "soluciones de IA fiables, transparentes y comprensibles").

"Como parte de Wand OS, hemos creado un panel de control para los agentes de IA", afirma Rotem Alaluf, Director ejecutivo de Wand AI. "Ofrece a los seres humanos una visibilidad completa del comportamiento de cada agente, desde las decisiones de alto nivel hasta cada token y mensaje generado. Una transparencia como esta es esencial para generar confianza. Cuando se puede entender por qué un agente toma determinadas decisiones, tanto a nivel macro como micro, y esas razones se ajustan a la lógica humana, se genera confianza en la fuerza laboral agencial y en los sistemas de IA en general".

IA emocional: generar confianza a través de la empatía y la capacidad de identificación

La IA emocional, también conocida como computación afectiva, se refiere a los modelos e interfaces de IA que pueden detectar, interpretar y responder adecuadamente a las señales emocionales humanas a partir de textos, expresiones faciales, entonación vocal y otras entradas. Esto puede generar confianza al permitir interacciones entre humanos y máquinas más empáticas y personalizadas, desde chatbots de servicio al cliente que responden adecuadamente al tono de voz cada vez más frustrado de un cliente, hasta sensores en el automóvil que detectan señales sutiles de fatiga del conductor, o software educativo que cambia de rumbo tras detectar el aburrimiento o la confusión de un estudiante.

"Para generar confianza en la IA es necesario un equilibrio entre el coeficiente intelectual y el coeficiente emocional", afirma Sean White, director ejecutivo de Inflection AI. "Aunque la mayor parte del sector se centra en potenciar la inteligencia bruta del razonamiento y la resolución de problemas de un modelo, creemos que la inteligencia emocional es igual de importante". Por eso creamos Pi, un agente de IA atractivo, empático, conversacional y sensible al contexto que combina el coeficiente intelectual y el coeficiente emocional para empoderar a las personas. La personalidad de Pi también es coherente en todas las versiones, y esa fiabilidad es fundamental para generar confianza a largo plazo.

Esta es solo una lista parcial de las tecnologías que pueden desempeñar un papel importante en la creación de confianza. Otras van desde tecnologías de autenticación para detectar información errónea (por ejemplo, marcas de agua digitales) hasta pruebas de conocimiento cero que permiten la verificación al tiempo que protegen la privacidad y la seguridad de los datos. Si la tecnología ha contribuido a alimentar la desconfianza, también puede formar parte de la solución.