EY verwijst naar de wereldwijde organisatie en kan verwijzen naar een of meer van de lidfirma's van Ernst & Young Global Limited, die elk een afzonderlijke juridische entiteit zijn. Ernst & Young Global Limited, een Britse vennootschap met beperkte aansprakelijkheid, verleent geen diensten aan cliënten.

Hoe EY kan helpen

-

EY Studio+ helpt organisaties om gepersonaliseerde ervaringen te creëren die aansluiten bij de behoeften van klanten en duurzame waarde op lange termijn genereren. Lees meer op studio.ey.com.

Lees meer

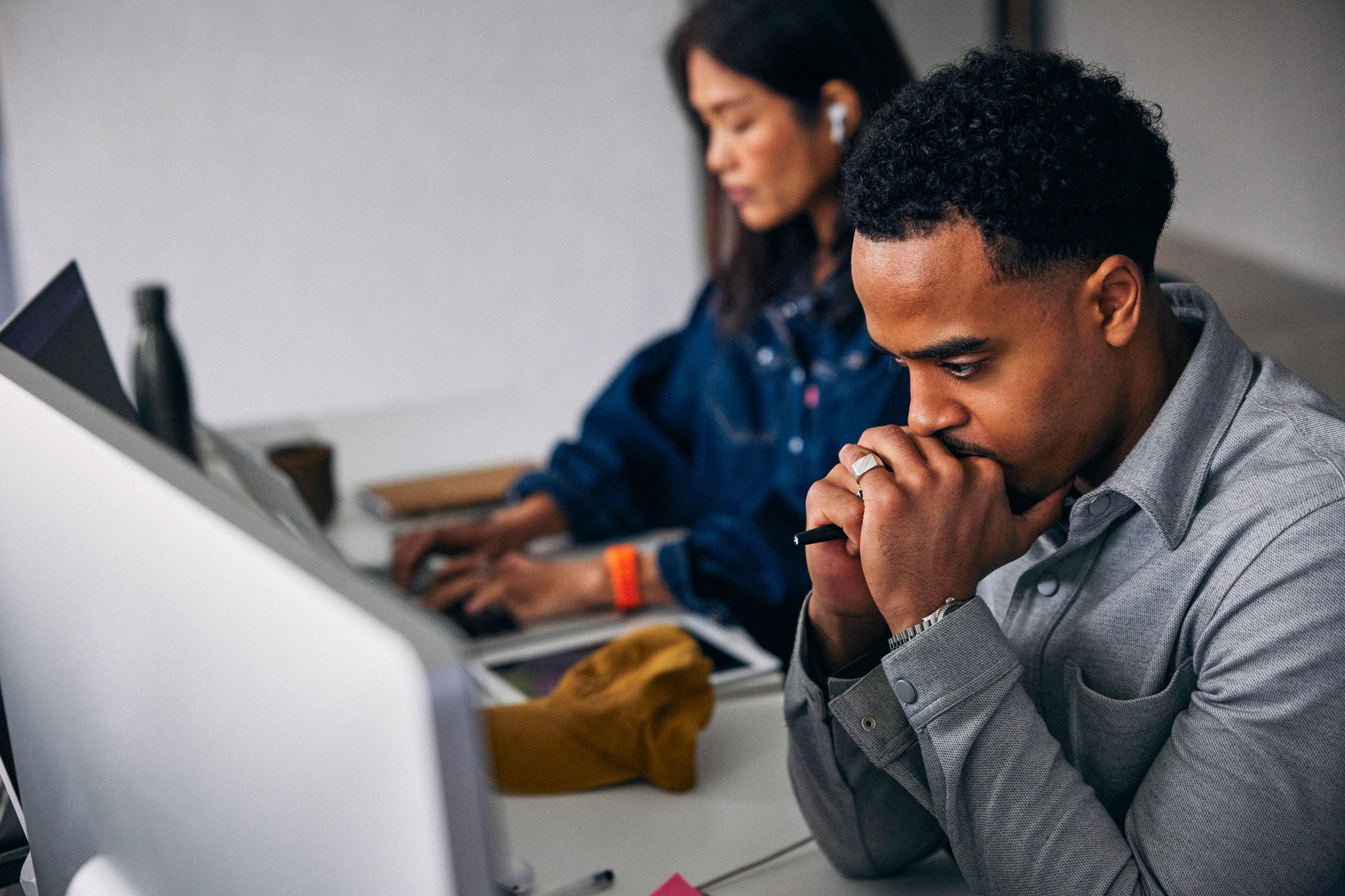

Een recent rapport van EY over het creëren van betrouwbare AI-ervaringen, laat zien hoe diep het ontwerp kan gaan op taal, tempo en duidelijkheid. In het rapport benadrukt Miki Van Cleave, Chief Design Officer voor Chase, de consumenten- en gemeenschapsbank van JPMorganChase, de hoeveelheid zorg die besteed moet worden aan het vormgeven van AI-gedreven interacties. "We zijn hier om vertrouwen op te bouwen en te beginnen met de mentaliteit van de consument te begrijpen," zegt Van Cleave. "We besteden buitensporig veel tijd aan het bedenken van de taal die klanten moeten horen, zodat het voor hen glashelder is wat ze aan het doen zijn. Bij fraudedetectie bijvoorbeeld, besteden we uren, dagen en weken aan het ontleden van elk zelfstandig naamwoord, werkwoord en bijvoeglijk naamwoord op een tussenpagina om ervoor te zorgen dat klanten weten wat ze moeten doen."

De behoefte aan duidelijkheid is niet cosmetisch. Het bepaalt of mensen het gevoel hebben dat ze de controle hebben, vooral in situaties waar veel op het spel staat, zoals in de financiële wereld.

Leiders zullen niet beslissen of AI meer autonoom wordt. Dat traject is al in beweging. Wat ze wel kunnen beslissen is hoe weloverwogen die autonomie wordt ingevoerd, waar ze wordt ingeperkt, waar ze wordt uitgebreid en hoe het vertrouwen onderweg wordt opgebouwd.

De meest succesvolle organisaties zullen niet diegene zijn die het snelst AI overal invoeren, of diegene die een afwachtende houding aannemen. Ze zullen design gebruiken om een weloverwogen tempo in te stellen, om te versnellen waar vertrouwen en waarde al bestaan, en te vertragen waar duidelijkheid, waarborgen of vertrouwen nog nodig zijn.