EY는 언스트앤영글로벌유한회사(Ernst & Young Global Limited) 조직, 또는 하나 이상의 멤버 법인을 지칭할 수 있으며, 각 멤버 법인은 서로 독립적인 법인입니다. 언스트앤영글로벌유한회사는영국의 보증책임 유한회사로 고객사에게 서비스를 제공하지 않습니다.

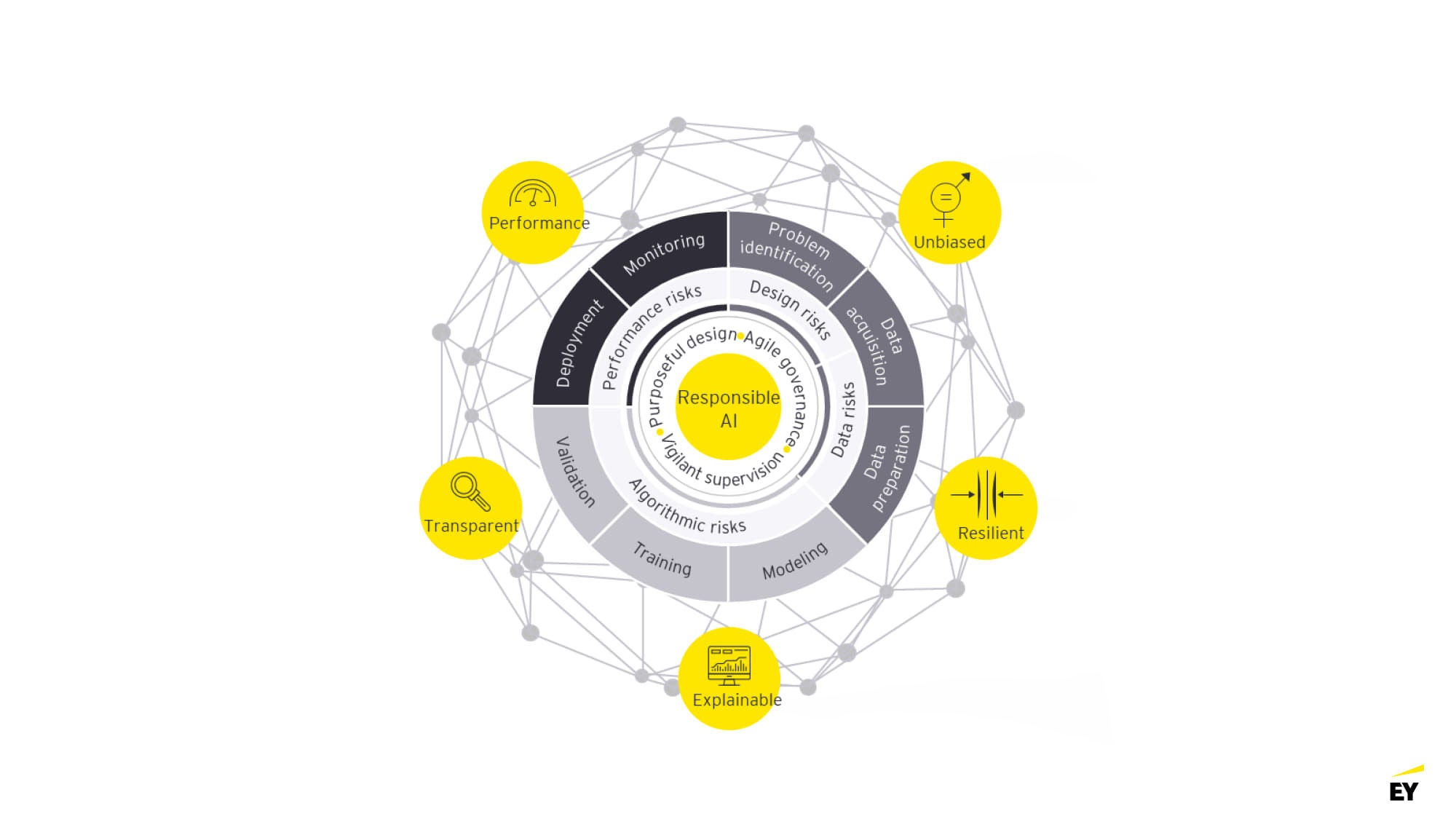

AI 규제가 본격화되는 2026년, 기업의 성패는 기술이 아닌 Responsible AI 거버넌스 역량에서 갈리고 있습니다.

In brief

- 2026년을 기점으로 글로벌 AI 규제가 동시 작동하며, 기업은 기술 역량이 아닌 AI를 책임 있게 관리하는 거버넌스 역량으로 평가받게 됩니다.

- 한국 기업은 외부 벤더의 AI를 활용하더라도 법적·사회적 책임을 부담하며, 복합 규제와 공급망, 재분류 리스크를 함께 관리해야 하는 환경에 놓여 있습니다.

- 글로벌 조사 결과는 성숙한 Responsible AI 체계를 갖춘 기업이 규제 대응을 넘어 혁신 속도와 신뢰, 성과 전반에서 우위를 확보하고 있음을 보여줍니다.

기원전 4세기, 양혜왕은 자신의 정원을 자랑하며 맹자에게 물었습니다. “현자도 이런 즐거움을 누립니까?” 맹자의 답은 분명했습니다. “현자라야 이를 즐길 수 있습니다. 어질지 못한 자는 이를 가져도 즐기지 못합니다.” 같은 정원이라도 이를 다스리는 그릇에 따라 축복이 되기도, 재앙이 되기도 한다는 뜻입니다.

2026년의 AI는 정확히 이 정원과 같습니다. 같은 모델, 같은 데이터, 같은 컴퓨팅 자원을 사용하면서도 어떤 기업은 신뢰와 성장을 얻고, 어떤 기업은 규제 위반·평판 손상·금전적 손실을 겪습니다. 차이는 기술이 아니라 거버넌스, 즉 책임 있게 AI를 다루는 구조의 유무입니다. 이것이 지금 ‘Responsible AI’를 주목해야 하는 이유입니다.

2026년, 여섯 개의 규제 시계가 동시에 움직이고 있습니다.

2026년은 글로벌 AI 규제가 동시에 작동하기 시작하는 해입니다. 한국 AI기본법, EU AI Act 고위험 AI 의무, 베트남 AI Law, 미국 콜로라도 AI Act, 캘리포니아의 프런티어 AI 규제, 그리고 미국 연방 차원의 행정명령까지 한국 기업은 최소 6개 법역의 상이한 규제 요구를 동시에 관리해야 합니다.

문제는 단순한 ‘법의 개수’가 아닙니다. AI 규제는 결코 단독으로 작동하지 않습니다. 개인정보 보호, 사이버보안, 제품안전, 저작권, 금융 감독, 수출통제, 노동, 경쟁법, ESG 공시까지 9개 인접 규제 영역이 AI와 결합해 복합 규제를 형성합니다. 하나의 AI 시스템이 평균 3~5개의 규제 틀에 동시에 걸리게 되는 구조입니다.

더 근본적인 어려움은 AI의 대부분이 외부에서 들어온다는 점입니다. 한국 기업이 사용하는 AI의 대다수는 외부 벤더의 모델, API, SaaS, 또는 AI가 내장된 제품입니다. 통제는 공급사에 있지만, 법적·사회적 책임은 AI를 사용하는 우리 기업에 귀속됩니다. 2026년 한국 임원이 마주한 현실은 바로 이 지점에 있습니다.

글로벌 데이터가 보여주는 현실은 냉정합니다.

EY가 21개국 C-suite를 대상으로 실시한 글로벌 조사 결과는 불편한 진실을 드러냅니다. 대부분의 기업이 이미 AI를 도입했지만, 책임 있는 AI 거버넌스를 갖춘 기업은 소수에 불과합니다. 그 격차는 이미 평균 수백만 달러 규모의 손실로 현실화되고 있으며, 가장 흔한 AI 리스크로 ‘규제 미준수’가 지목되고 있습니다.

그러나 같은 조사에서 또 하나의 중요한 메시지가 나옵니다. Responsible AI 성숙도가 높은 기업은 혁신 속도, 운영 효율, 직원 만족, 매출 성장, 비용 절감에서 동시에 우위를 보입니다. 책임 있는 AI는 리스크를 줄이는 방어 수단이 아니라, 성과를 만들어내는 경영 자산이라는 점이 데이터로 확인됩니다.

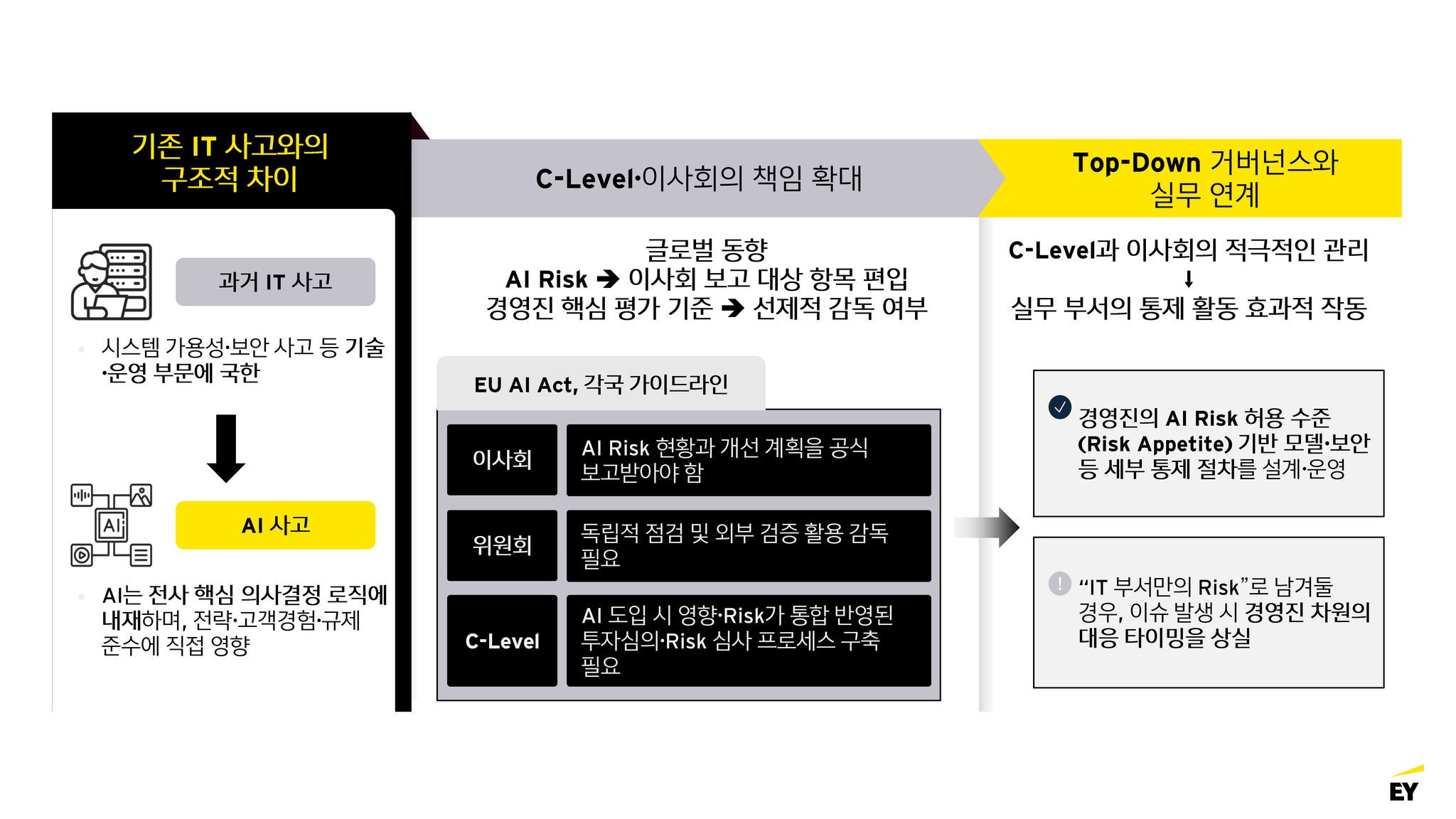

문제는 인식의 격차입니다. 많은 임원들이 “AI 리스크를 어떻게 통제해야 하는지”를 정확히 알지 못한 채, 알고 있다고 가정하고 의사결정을 내리고 있습니다. 이사회 차원에서 AI 리스크가 정기적으로 논의·보고되지 않는 기업은 이미 글로벌 평균보다 한 발 이상 뒤처져 있게 됩니다.

복잡한 규제를 하나로 묶는 ‘공통 언어’로 AI Risk Management 체계를 도입해야 합니다.

여섯 개의 법은 서로 다른 표현과 구조를 가지고 있지만, 실무적으로 보면 놀라울 정도로 공통된 질문을 던지고 있습니다.

- 이 AI는 무엇을 위해 사용되는지 확인해야 합니다.

- 누구에게 어떤 영향을 미치는지 주기적으로 평가해야 합니다.

- 리스크는 어떻게 식별·측정·관리되는지 운영 체계를 마련해야 합니다.

- 사고가 발생했을 때 누가 책임지고 어떻게 대응하는지에 대한 기준이 필요합니다.

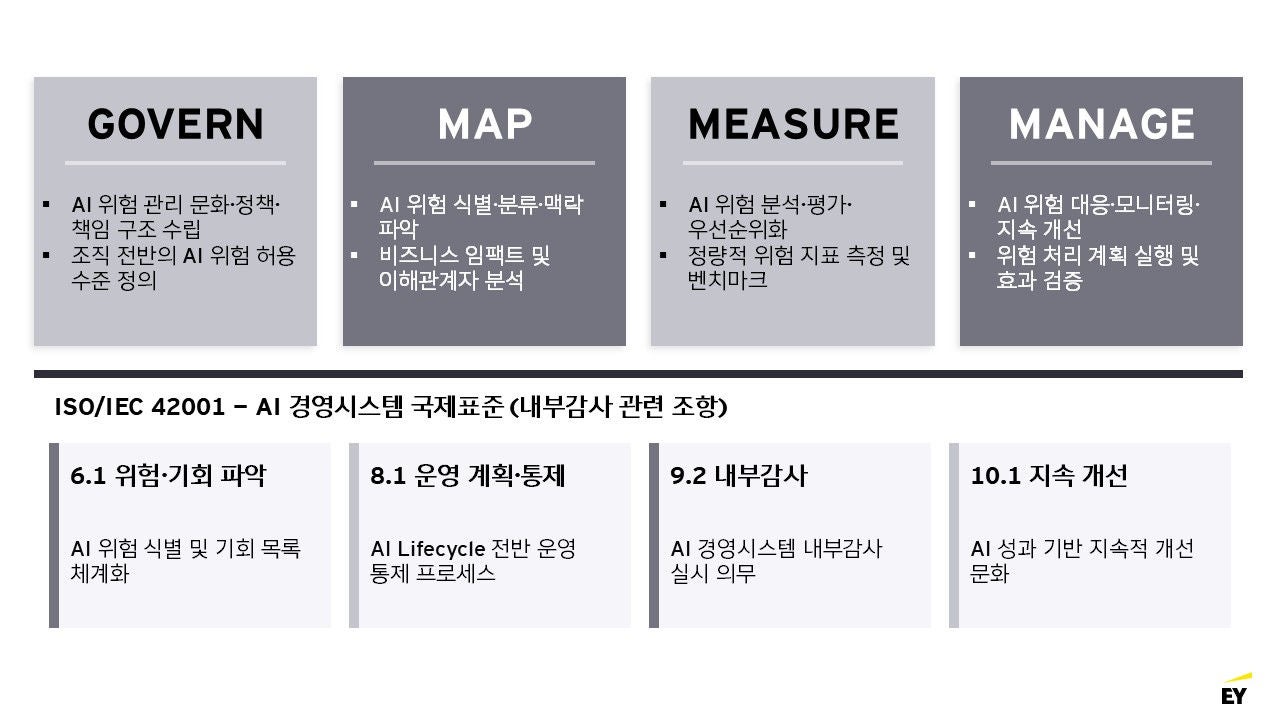

이 질문들을 하나의 구조로 묶는 공통 언어가 바로 NIST AI Risk Management Framework(NIST AI RMF)입니다. 강제력이 없는 자발적 표준이지만, 한국 AI기본법, EU AI Act, 미국 주(州)법, ISO/IEC 42001까지 모두 이 구조와 정렬되고 있습니다.

NIST AI RMF는 AI 거버넌스를 네 가지 기능으로 단순화합니다.

- GOVERN: 정책, 역할, 책임, 자원을 정립하는 거버넌스

- MAP: AI의 목적, 맥락, 이해관계자, 영향을 식별

- MEASURE: 위험을 정성·정량적으로 평가하고 검증

- MANAGE: 위험을 완화하고 지속적으로 모니터링·개선

이 구조는 새로운 것이 아닙니다. 기존 사이버보안, 전사적 리스크 관리(ERM)에 익숙한 조직이라면 빠르게 AI까지 확장할 수 있습니다. 그래서 글로벌 선도 기업들은 ‘법별 대응’이 아니라 NIST RMF를 기준선(baseline)으로 삼고, 각 법역의 차이는 프로파일로 관리하고 있습니다.

공급망과 ‘재분류’ 리스크는 가장 놓치기 쉬운 함정입니다.

EU AI Act가 특히 날카롭게 짚는 지점은 AI 가치사슬의 책임 이동입니다. 한국 기업의 대부분은 AI를 개발하는 제공자(provider)가 아니라 사용하는 도입자(deployer)이지만, 일정 조건이 충족되면 즉시 제공자의 의무를 떠안게 됩니다.

외부 AI에 자사 브랜드를 붙여 출시하거나, 모델을 실질적으로 수정·파인튜닝하거나, 사용 목적을 변경해 고위험 영역에 적용하는 순간 책임의 성격이 바뀝니다. 많은 기업이 ‘단순 도입자’라는 인식에 안주하다가, 규제상 제공자로 재분류되는 위험을 간과할 수 있습니다.

따라서 앞으로 AI 거버넌스의 핵심은 ‘우리 AI를 잘 만드는 것’이 아니라 ‘남의 AI를 어떻게 책임 있게 쓰는가’에 있습니다. 벤더 선정, 계약, 영향평가, 사고 통지, 변경 관리가 모두 거버넌스의 일부가 되기 때문입니다.

Responsible AI는 비용이 아니라 자본으로 인식해야 합니다.

2026년은 글로벌 AI 거버넌스의 변곡점입니다. 규제는 이미 시작되었고, 유예는 준비를 늦추라는 신호가 아닙니다. 이제 기업의 선택지는 명확합니다. 규제를 최소한 통과하는 수준에 머물 것인가, 아니면 AI 신뢰를 경쟁력으로 전환할 것인가를 결정해야 합니다.

Responsible AI는 윤리 선언이나 추가 비용이 아닙니다. 글로벌 고객의 AI 공급자 평가를 통과하고, 새로운 시장에 진입하며, 기업의 신뢰를 매출로 연결하는 자본입니다. 기술을 보유한 기업이 아니라, 책임 있게 기술을 다룰 수 있는 기업이 AI 대전환의 시대에 승자가 될 수 있습니다. 지금이 바로 그 그릇을 만드는 시점이고, Responsible AI의 출발점입니다.

요약

2026년을 기점으로 글로벌 AI 규제가 본격화되면서, 기업의 경쟁력은 기술 도입이 아니라 AI를 책임 있게 관리하는 역량에서 갈리고 있습니다. 외부 벤더 AI를 활용하더라도 책임은 기업에 귀속되며, 복합 규제와 공급망 리스크에 대한 체계적 대응이 요구됩니다. Responsible AI 거버넌스는 이제 규제 대응을 넘어 신뢰와 성과를 만들어내는 경영의 출발점이 되고 있습니다.