EY refere-se à organização global e pode se referir a uma ou mais das firmas-membro da Ernst & Young Global Limited, cada uma das quais é uma entidade legal separada. A Ernst & Young Global Limited, uma empresa britânica limitada por garantia, não presta serviços a clientes.

Como a EY pode ajudar

-

A solução EY Customer Experience pode ajudar sua empresa a integrar programas CX que ajudam a fornecer valor sustentável a longo prazo. Descubra mais.

Leia mais

Um relatório recente da EY sobre a criação de experiências confiáveis baseadas em IA (pdf) destaca o quanto o design pode se resumir à linguagem, ao ritmo e à clareza. No relatório, Miki Van Cleave, Chief Design Officer do Chase, o banco comunitário e de consumo do JPMorganChase, enfatiza a quantidade de cuidado que deve ser tomado para moldar as interações orientadas por IA. "Estamos aqui para criar confiança e partir de um ponto de vista de compreensão da mentalidade do consumidor", diz Van Cleave. "Passamos um tempo excessivo pensando na linguagem que os clientes precisam ouvir para que eles saibam claramente o que estão fazendo. Por exemplo, com a detecção de fraudes, passaremos horas, dias e semanas dissecando cada substantivo, verbo e adjetivo em uma página intersticial para garantir que ela ajude os clientes a saber o que fazer."

A necessidade de clareza não é cosmética. Ela determina se as pessoas se sentem no controle, principalmente em contextos de alto risco, como o financeiro.

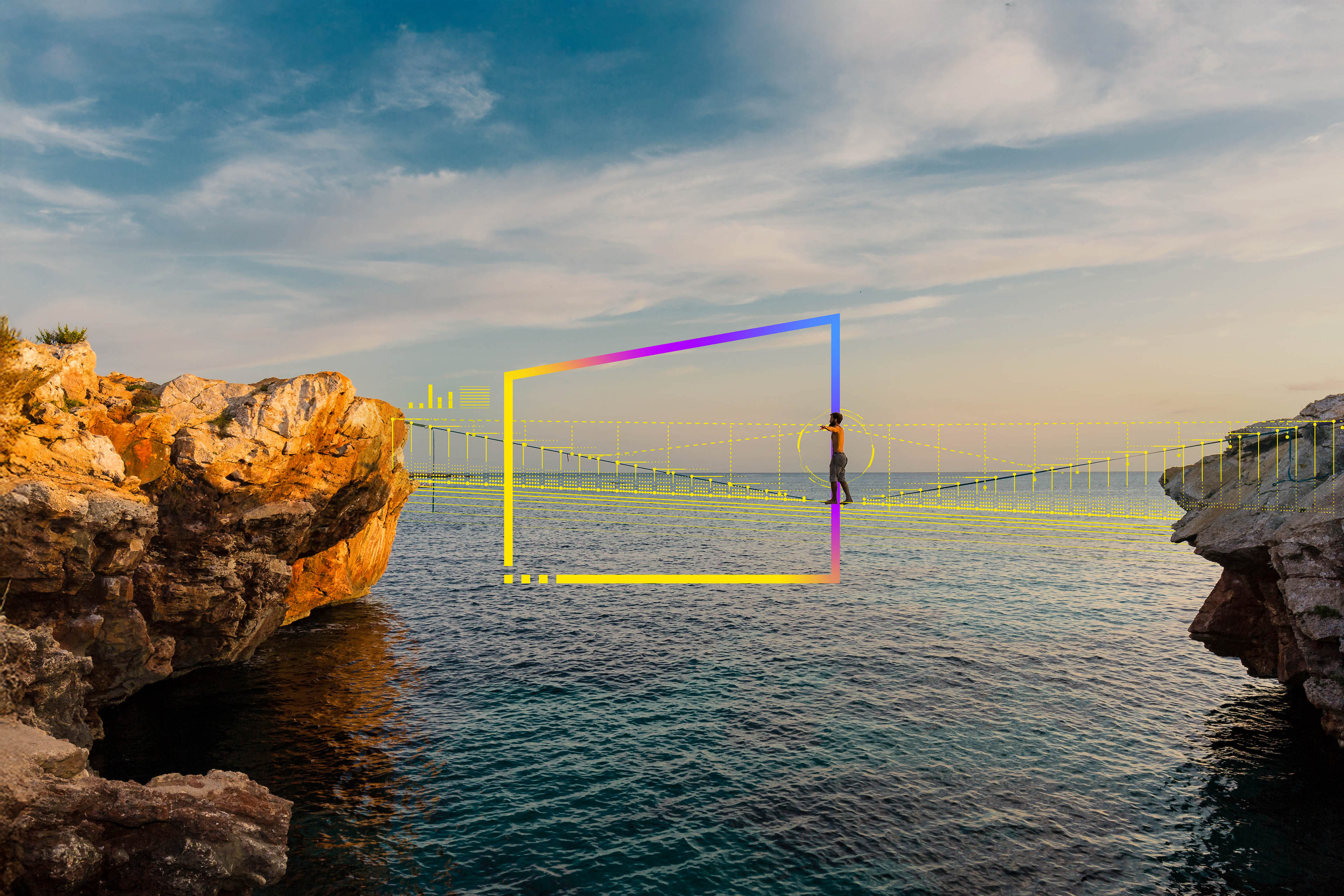

Os líderes não decidirão se a IA se tornará mais autônoma. Essa trajetória já está em andamento. O que eles podem decidir é como essa autonomia é introduzida deliberadamente — onde ela é restringida, onde é expandida e como a confiança é construída ao longo do caminho.

As organizações mais bem-sucedidas não serão aquelas que se moverem mais rapidamente para introduzir a IA em todos os lugares ou aquelas que adotarem uma abordagem de esperar para ver. Eles usarão o design para definir um ritmo deliberado — para acelerar onde já houver confiança e valor, e desacelerar onde ainda houver necessidade de clareza, salvaguardas ou confiança.