EYとは、アーンスト・アンド・ヤング・グローバル・リミテッドのグローバルネットワークであり、単体、もしくは複数のメンバーファームを指し、各メンバーファームは法的に独立した組織です。アーンスト・アンド・ヤング・グローバル・リミテッドは、英国の保証有限責任会社であり、顧客サービスは提供していません。

エンドツーエンド AIレッドチーミング

生成AI(GenAI)/LLMを組み込んだアプリを、不正利用・悪用・コンプライアンス違反を想定したシナリオで評価。プロンプト操作やRAG汚染、エージェントの誤動作などAI特有の脆弱性を洗い出し、統制された検証環境において実運用上の影響を検証。経営層向け要約と実行可能な是正策を提供します。

提供価値: 実際に起こり得るAI特有のリスクの把握・可視化から、意思決定までを支援

生成AI/LLMを活用したアプリケーションは、機密情報の処理、意思決定支援、ツール連携やエージェントによる自律的なアクションなど、ビジネスの中核を担う存在になりつつあります。一方で、プロンプト操作やRAG(Retrieval Augmented Generation)汚染、ツールの不正利用、個人情報や機密情報、知的財産の漏えいのような意図しない情報開示や許可された権限を越えた回答などといったAI特有のリスクが顕在化しており、従来のセキュリティ評価だけでは十分とは言えません。

本サービスは、クライアントの合意のもと、現実的な攻撃・悪用シナリオに基づき、生成AI固有の攻撃対象領域を攻撃者視点で検証することで、「本当に悪用可能か」「ビジネスにどのような影響があるのか」といった生成AI特有の代表的なリスクとその影響の把握・評価を支援します。

サービスの特長:

1. 脅威シナリオに基づく実践的な検証

実際に想定される不正利用・悪用・コンプライアンス違反行為をシナリオ化し、以下のような観点で検証します。

- プロンプトインジェクション、ジェイルブレイク

- RAGの汚染・不正誘導

- ツール/APIの不正利用

- 危険なエージェント挙動や権限逸脱

2. 悪用可能性と影響度の現実的な検証

机上のリスク整理にとどまらず、実際に成立する攻撃経路(アタックパス)を検証し、信頼境界の弱点、影響範囲、深刻度の根拠を明確にします。

3. 意思決定に資するガバナンス視点のレポーティング

セキュリティ部門だけでなく、法務部門や経営層とも共有できる形でリスクを整理し、優先順位付けと具体的な対応検討の参考となる情報を提供します。

4. 再検証(オプション)

対策後に再評価を行い、リスク低減の実効性を確認することも可能です。

対象範囲(例)

- LLMを活用したアプリケーションおよび各種連携

- RAGパイプライン、検索データソース、ベクターデータベース、埋め込み(Embeddings)

- エージェント型ワークフロー、プラグイン/コネクタ、内部・外部API連携

※特に合意がない限り、本番環境に影響を与えるDoS行為や、対策の実装作業は対象外です。

※RAG(Retrieval Augmented Generation)とは

RAGとは、LLMの回答精度や関連性を高めるために、内部または外部のデータソースから情報を動的に取得し、生成プロセスに組み込むアーキテクチャです。一方で、データソースや埋め込みの管理状況などに依存するものの、これらが汚染された場合には、誤情報生成や意図しない判断誘導につながるリスクがあります。

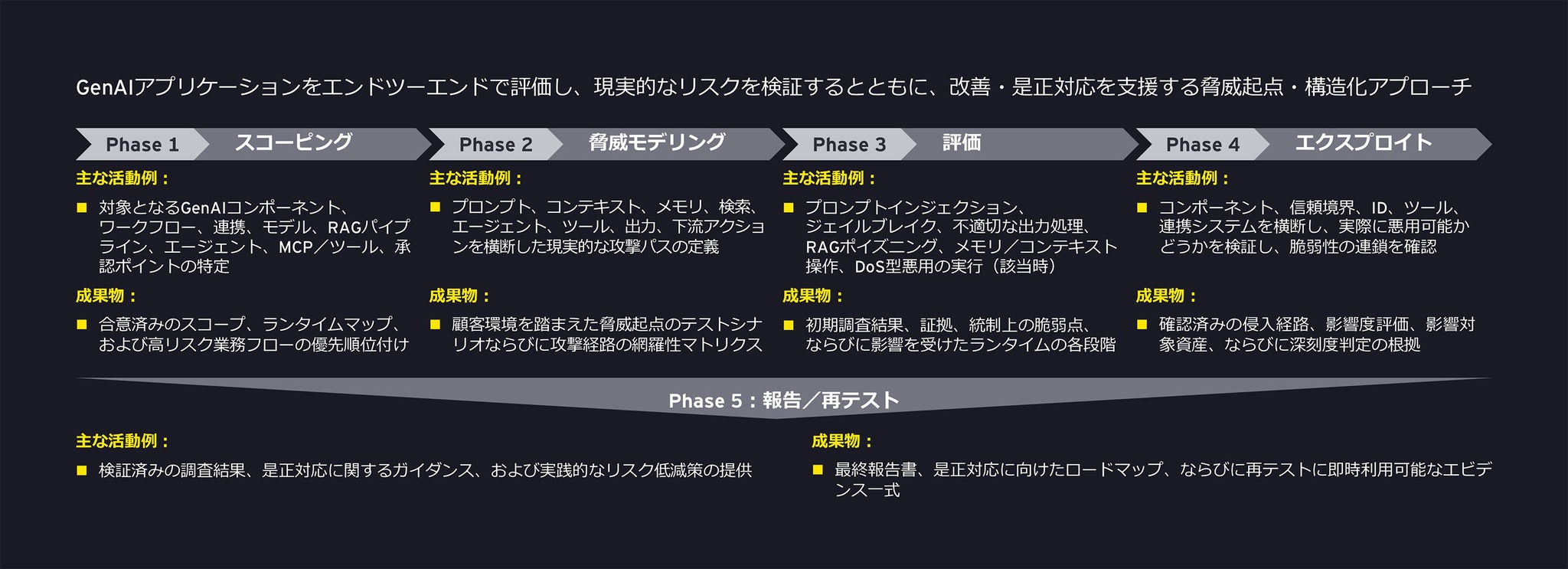

評価手順

- スコーピング:対象システム、ワークフロー、制約条件を定義

- 脅威モデリング:OWASP・MITRE ATLASに基づく現実的な悪用シナリオを設計

- シミュレーション:プロンプト操作、ジェイルブレイク、RAG汚染、ツール不正利用などを実行

- 統制された検証:悪用可能性、影響、深刻度の根拠を確認

- 報告・再検証(オプション):改善提言の提示、必要に応じた再テストを実施

フレームワークとの整合性

- OWASP:生成AI/LLMアプリケーション特有のリスクを網羅

- NIST AI RMF:ガバナンスを重視したAIリスク管理の枠組み

- MITRE ATLAS:脅威起点の攻撃シナリオ・攻撃経路設計

提供物(例)

- 経営層向けエグゼクティブサマリー(優先度の高いリスクと次のアクションを含む)

- 技術詳細レポート(攻撃経路の証跡、影響分析、深刻度の根拠、改善提言)

- 生成AI攻撃対象領域・シナリオのカバレッジ整理

- オプション:対策後の再検証レポート

*本サービスによる検証は一定の前提条件および想定シナリオのもとで実施されるものであり、すべてのリスクを完全に網羅または排除すること、もしくは特定の結果や効果を保証するものではありません。

EYの関連サービス

-

企業におけるサイバー攻撃の脅威はますます深刻になっています。セキュリティ対策の水準に対する社会的要請も高まっており、グローバル企業においては海外拠点を含めたセキュリティ態勢の向上が求められており、さらには、サプライチェーンにおいても対策が求められています。

続きを読む -

脅威ベースのペネトレーションテスト(TLPT)は、システムの脆弱(ぜいじゃく)性を評価するテスト手法の1つです。高度化するサイバー攻撃から組織を守るためには、組織が直面する脅威を把握し、サイバー攻撃への耐性を継続的に検証・改善していくことが求められます。EYは脅威情報に基づいたサイバー攻撃シミュレーションを通じて、組織におけるシステム、人的要素、プロセスに関する脆弱性を特定し、改善策を提案いたします。

続きを読む -

デジタル変革と不確実性の高い社会環境の変化にさらされる金融セクターのクライアントがサイバーリスクを適切にコントロールすることで、顧客とデータを保護し、イノベーションにより競争力を高めて飛躍的な成長を遂げられるよう、包括的なサイバーセキュリティサービスを提供します。

続きを読む